robots协议

robots协议就是robots.txt文件,是一个被放置在网站中的.TXT文件,为搜索引擎爬虫做出提示,设置允许或者不允许两种搜索语句,网络爬虫据此判断抓取或者不抓取该网页内容。即网站通过robots协议高速搜索引擎哪些页面可以抓取,哪些页面不能抓取的。robots协议的目的是保护网站数据和敏感信息、确保用户个人信息和隐私不被侵犯。

robots协议功能用处

网站站长使用robots协议决定对搜索引擎的开放程度,引导爬虫如何更有效地爬取自己,可以屏蔽一些网站中比较大的文件,节省服务器带宽;可以屏蔽掉网站上的一些死链接。方便搜索引擎抓取网站内容;也可以指明对那个搜索引擎开放,或者对哪个不开放。设置网站地图连接,方便引导蜘蛛爬取页面。

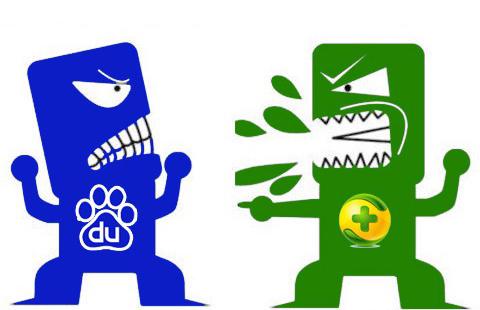

robots协议案例

2013年10月16日,百度以奇虎360违反其设定的“Robots协议”抓取、复制其网站内容为由将奇虎360告上法庭,索赔1亿元人民币。历时一年终于宣判,最终以奇虎360赔偿百度70万人民币而告终。但有业内人士分析,百度robots协议仅仅禁止360搜索引擎抓取,缺允许谷歌、必应等抓取百度的内容,是把robots协议当成不正当的竞争工具,来打击360搜索(此信息来源网络,仅供参考)。

robots.txt协议在seo中的作用

robots能规范网站的URL,网站有两种甚至3种以上地址的时候,该协议就能禁止蜘蛛爬去你不想展示的几种URL,而使网站解决站内重复问题集中权重。robots协议可以控制蜘蛛抓取站长需要抓取的某些有效有价值的信息,减轻对服务器的负担。

怎么写robots协议

robots协议其实很简单的几句代码即可达到站长想到的结果,例如:Disallow: /comments/feed/#禁止所有引擎抓取网站comments目录下的feed目录。网络上也有很多的工具可以帮助实现此项功能,例如站长工具的robots.txt生成工具,就能够快速的实现。

作者:CMO小秘

来源:CMO原创